- Home

- /

- लाइफ स्टाइल

- /

- Lifestyle: कैसे कलाकार...

लाइफ स्टाइल

Lifestyle: कैसे कलाकार कृत्रिम बुद्धिमत्ता के खिलाफ लड़ रहे

Ayush Kumar

21 Jun 2024 5:29 PM IST

x

Lifestyle: स्वामित्व के विचार केवल 12,000 साल पुराने हैं, लेकिन जब से वे उभरे हैं, उन्हें सुदृढ़ और संरक्षित किया जाना चाहिए। तो शायद यह उचित है कि एक नया तकनीकी उपकरण जो कलाकारों को उनके काम को AI प्रोग्राम द्वारा उपयोग से बचाने में मदद करता है, उसका नाम एक प्राचीन सीमा पत्थर से लिया गया है। बेबीलोनिया में, कासाइट राजवंश (16वीं से 12वीं शताब्दी ईसा पूर्व) के दौरान, भूस्वामी अपने भूखंडों के किनारों को उत्कीर्ण पत्थरों से चिह्नित कर सकते थे। कुदुरू कहे जाने वाले ये स्लैब राहगीरों को सचेत करते थे कि वे निजी संपत्ति पर अतिक्रमण करने वाले हैं; लेकिन वे इससे भी ज़्यादा करते थे। वे उन लोगों पर अभिशाप लगाने की धमकी देते थे जो किसी भी तरह से सीमा पार करना चुनते थे। इतने सालों बाद, अक्टूबर में स्पॉनिंग AI द्वारा लॉन्च किया गया कुदुरू नामक एक उपकरण, रचनाकारों को उनके काम को AI-प्रशिक्षण डेटासेट से बाहर रखने में मदद कर रहा है। यह उपकरण स्क्रैपर्स के IP पतों के लिए लोकप्रिय डेटासेट को स्कैन करके और उन्हें ब्लॉक करके ऐसा करता है ताकि वे संरक्षित कार्य तक न पहुँच सकें। स्क्रैपर्स को अस्वीकार करने के अलावा, यह अपने क्लाइंट, कलाकार को एक वैकल्पिक छवि चुनने की अनुमति देता है जिसे नेटवर्क वापस ले लेगा। इन प्रलोभनों में आम तौर पर मीम्स और प्रैंक वीडियो शामिल होते हैं। निजी, संवेदनशील और कॉपीराइट सामग्री को घूमते हुए बॉट्स से बचाने की लड़ाई में यह यहीं तक पहुँच गया है। कुदुरू और इसके जैसी अन्य सशुल्क और मुफ़्त सेवाओं के उपयोगकर्ताओं के लिए उम्मीद यह है कि व्यवधान - इसके लिए शब्द "डेटासेट को जहर देना" है - जनरेटिव AI प्रोग्राम के प्रशिक्षण को इतना विकृत कर देगा कि बॉट्स अंततः आगे बढ़ने की कोशिश करना बंद कर देंगे, और ऐसे फ़ायरवॉल-संरक्षित कंटेंट को अकेला छोड़ देंगे।

इस तरह के जहर के प्रयासों का पता 2020 में लगाया जा सकता है, जब शिकागो विश्वविद्यालय में कंप्यूटर वैज्ञानिकों की एक टीम ने सॉफ़्टवेयर टूल फॉक्स (ऑनलाइन हैकटिविस्ट द्वारा इस्तेमाल किए जाने वाले गाइ फॉक्स मास्क से प्रेरित नाम) बनाया था। यह टूल व्यक्तिगत गोपनीयता सुरक्षा के प्रयासों में किसी व्यक्ति की सार्वजनिक रूप से उपलब्ध तस्वीरों में छिपे हुए बदलाव जोड़ता है। पिक्सेल-स्तर के परिवर्तन मानव आंखों के लिए अदृश्य हैं, लेकिन वेबसाइट बताती है कि वे "किसी भी चेहरे की पहचान करने वाले मॉडल के लिए ट्रोजन हॉर्स" के रूप में कार्य करते हैं, जिससे स्पष्ट चेहरे के बजाय, छवि का अत्यधिक विकृत संस्करण प्राप्त होता है। शिकागो की टीम यहीं नहीं रुकी। 2022 तक, बेन झाओ और हीथर झेंग के नेतृत्व में वैज्ञानिक, छवि-क्लोकिंग की इस पद्धति को ऐसे तरीकों से विस्तारित करने में सक्षम थे, जो मिडजर्न और स्टेबिलिटी एआई जैसे जनरेटिव मॉडल को भी बाधित करते थे, ताकि कलाकार की सहमति के बिना (और इसलिए क्रेडिट या मुआवजे के बिना) एक्सेस की गई छवियों की सुरक्षा की जा सके। वे तब से अपनी पेशकशों का विस्तार कर रहे हैं। मार्च 2023 में लॉन्च किया गया ग्लेज़ समस्या के एक अलग पहलू से निपटता है: शैली की नकल। डिजिटल आर्टवर्क में न्यूनतम परिवर्तनों का एक सेट पेश करके, यह ब्रश स्ट्रोक, चेहरे के विवरण और रंग पैलेट को छिपा देता है या अस्पष्ट कर देता है ताकि किसी काम की अनूठी शैली के महत्वपूर्ण तत्व कंप्यूटर प्रोग्राम के लिए दुर्गम हो जाएं। परिणामस्वरूप, एक यथार्थवादी चारकोल चित्र बॉट को अमूर्त कला कार्य के रूप में पंजीकृत कर सकता है।

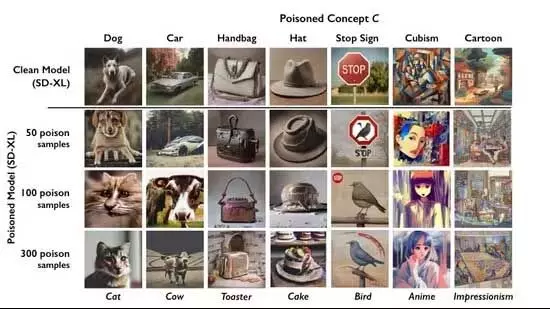

इस वर्ष लॉन्च किया गया नाइटशेड एक आक्रामक फ़ंक्शन प्रदान करता है, जो AI मॉडल द्वारा देखी गई छवि को बदलता है ताकि यह केवल अपने स्वयं के विवरण को छिपाने के बजाय प्रशिक्षण को बाधित करे। उदाहरण के लिए, हरे मैदान में आराम कर रही गाय की छायांकित छवि, एल्गोरिदम को घास पर एक बड़े चमड़े के पर्स की तरह दिखाई देगी। वेबसाइट बताती है, "गाय को शामिल करने वाली पर्याप्त संख्या में छायांकित छवियों पर प्रशिक्षित होने पर, एक मॉडल तेजी से आश्वस्त हो जाएगा कि गायों के पास अच्छे भूरे रंग के चमड़े के हैंडल और ज़िपर के साथ चिकनी साइड पॉकेट हैं, और शायद एक प्यारा ब्रांड लोगो है। ग्लेज़ और नाइटशेड का उपयोग सर्वोत्तम परिणामों के लिए संयोजन में किया जा सकता है, और वर्तमान में कलाकारों के लिए निःशुल्क हैं, क्योंकि उन्हें यूएस नेशनल साइंस फ़ाउंडेशन, यूएस डिफेंस एडवांस्ड रिसर्च प्रोजेक्ट्स एजेंसी (DARPA), Amazon Web Services (AWS), और एंटरप्राइज़ AI कंपनी C3 AI जैसे संगठनों से अनुसंधान अनुदान और दान द्वारा वित्त पोषित किया गया था। बॉट्स को पकड़ने में कितना समय लगेगा, और उन्हें बेवकूफ़ बनाने के लिए ज़रूरी दृश्य शोर कला के काम को ज़्यादा स्पष्ट तरीक़े से प्रभावित करना शुरू कर देगा? शिकागो के शोधकर्ताओं ने कहा है कि अभी के लिए क्लोकिंग ठीक उसी तरह काम करती है, जैसे आज AI मॉडल डिज़ाइन किए जाते हैं। लेकिन पहले से ही, ग्लेज़ कलात्मक शैलियों में बदलावों को नज़रअंदाज़ रखने के तरीके खोजने के लिए संघर्ष कर रहा है। कुडुरु, जो एक घंटे में लगभग 50 स्क्रैपर IP पतों की पहचान करता है, उन्हें केवल अस्थायी रूप से ब्लॉक करता है क्योंकि वे बदलते रहते हैं। सबसे यथार्थवादी उम्मीद यह है कि प्रशिक्षण मॉडल को होने वाला नुकसान इतना हतोत्साहित करेगा कि AI कंपनियाँ इसके बजाय ओपन-सोर्स इमेजरी का उपयोग करना चुनेंगी, या कलाकारों को उनके काम के लिए भुगतान करेंगी। यह एक ऐसा सपना है जिसके लिए लड़ने लायक है। जैसा कि झाओ ने NPR के साथ एक साक्षात्कार में कहा: "मैं एक ऐसी दुनिया लाना चाहूँगा जहाँ AI की सीमाएँ हों... सुरक्षा रेखाएँ... नैतिक सीमाएँ जो उपकरणों द्वारा लागू की जाती हैं।" क्योंकि कानून, ठीक है, उन्हें पकड़ने में बहुत लंबा समय लगने वाला है।

ख़बरों के अपडेट के लिए जुड़े रहे जनता से रिश्ता पर

Tagsकलाकारकृत्रिमबुद्धिमत्ताखिलाफartistartificialintelligenceagainstजनता से रिश्ता न्यूज़जनता से रिश्ताआज की ताजा न्यूज़हिंन्दी न्यूज़भारत न्यूज़खबरों का सिलसिलाआज की ब्रेंकिग न्यूज़आज की बड़ी खबरमिड डे अख़बारJanta Se Rishta NewsJanta Se RishtaToday's Latest NewsHindi NewsIndia NewsKhabron Ka SilsilaToday's Breaking NewsToday's Big NewsMid Day Newspaperजनताjantasamachar newssamacharहिंन्दी समाचार

Next Story